2024年6月15日,由國內多家頂尖網絡安全機構聯合主辦的“智見破境——2024網絡安全運營實戰大會”在北京國家會議中心隆重開幕。本次大會以“實戰驅動,智御未來”為核心主題,匯聚了來自政府、企業、高校及研究機構的數千名網絡安全專家、學者與從業者,共同探討在人工智能技術浪潮下,網絡安全運營面臨的新形勢、新挑戰與實戰解決方案。其中,人工智能基礎軟件(AI Infrastructure Software)的安全開發與治理,成為本屆大會最受關注的前沿焦點。

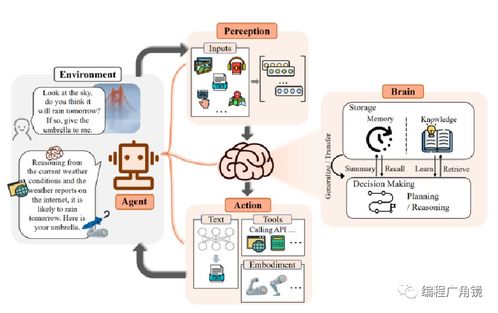

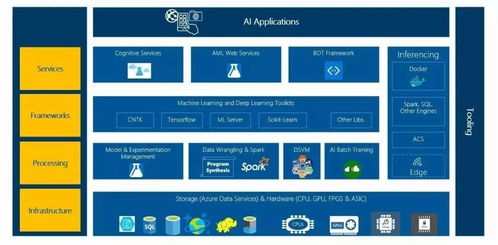

隨著ChatGPT等生成式人工智能的爆發式應用,人工智能技術已深度滲透至各行各業的核心業務系統。作為AI模型訓練、部署與運行的底層支撐,人工智能基礎軟件——包括機器學習框架(如TensorFlow, PyTorch)、大規模數據處理平臺、模型服務平臺及各類AI開發工具鏈——其安全性直接關系到上層AI應用的可靠性與整個數字生態的穩定。AI基礎軟件在帶來巨大效能提升的也因其復雜性、開源依賴性及新型架構特點,引入了前所未有的安全風險。

在大會主論壇上,中國工程院院士、網絡安全專家李明教授發表了題為《筑牢智能時代的安全基座:AI基礎軟件開發生命周期安全》的主旨演講。他指出:“人工智能基礎軟件已構成數字社會的‘新基建’。其安全漏洞不僅可能導致模型被投毒、數據泄露、服務中斷等傳統風險,更可能引發模型偏見固化、決策邏輯被惡意操控等新型系統性風險。我們必須將安全能力‘左移’,深度嵌入AI基礎軟件的需求設計、代碼開發、供應鏈管理及持續運營的全生命周期之中。”

本次大會特設“AI基礎軟件安全”專題分論壇,議題深入且極具實戰性。來自頭部科技公司的安全實驗室負責人分享了他們在自研AI框架中實施“安全-by-Design”原則的實踐,包括在軟件架構層面集成機密計算、差分隱私保護模塊,以及建立針對AI模型的專項模糊測試(Fuzzing)與對抗樣本檢測體系。多家專注于軟件供應鏈安全的廠商展示了針對AI開源組件(如Hugging Face模型庫、PyPI中的AI相關包)的自動化漏洞與后門掃描方案,以應對日益嚴峻的供應鏈攻擊威脅。

與會專家們熱烈討論了AI基礎軟件開發帶來的新挑戰:

- 復雜性挑戰:AI軟件棧層次多、技術新,傳統安全工具和方法存在盲區,需要發展適應AI特性的新型安全分析技術。

- 數據與模型安全:訓練數據污染、模型竊取與逆向攻擊成為新的攻擊面,要求基礎軟件具備更強的數據溯源和模型保護能力。

- 合規與倫理挑戰:隨著全球對AI監管的加強(如歐盟《人工智能法案》),基礎軟件開發必須內置可解釋性、公平性審計與合規性驗證接口。

- 人才缺口:兼具深厚AI技術理解與網絡安全實戰能力的“AI安全工程師”極為稀缺,成為產業發展的關鍵瓶頸。

為促進產、學、研、用協同,大會現場發布了《人工智能基礎軟件安全開發實踐指南(2024)》征求意見稿,并啟動了“AI安全開源組件共創計劃”,旨在聯合產業力量,共同構建更安全、可信的AI軟件開發環境。

“智見破境”2024網絡安全運營實戰大會的成功舉辦,標志著中國網絡安全產業正將戰略目光投向更深層的技術基礎。在人工智能定義軟件的新時代,確保AI基礎軟件的安全,已不僅僅是技術問題,更是關乎國家數字主權、經濟安全與社會穩定的戰略議題。大會凝聚的共識與展示的實戰成果,將為各行各業安全地擁抱人工智能、筑牢智能時代的數字防線提供至關重要的思路與路徑。